Crawlability & Indexability

Περιεχόμενα

- Τι είναι Crawlability

- Τι είναι Indexability

- Πώς λειτουργεί το Googlebot — τα 3 στάδια

- Crawlability, Indexability και LLMO: η σύνδεση

- Τα 6 πιο συνηθισμένα προβλήματα crawlability

- Τα 4 πιο συνηθισμένα προβλήματα indexability

- Πώς ελέγχεις αν το site σου crawl-αρεται σωστά

- Θέλεις technical SEO audit;

- Συχνές ερωτήσεις για Crawlability & Indexability

- Συμπέρασμα

Υπάρχει ένα παράδοξο που βλέπουμε συχνά: επιχειρήσεις που επενδύουν χρόνο και χρήμα σε content marketing, SEO, και LLMO optimization — αλλά το Googlebot δεν μπορεί να φτάσει τις σελίδες τους. Το αποτέλεσμα είναι τραγικό: μηδενική ορατότητα, ανεξάρτητα από την ποιότητα του content.

Το crawlability και το indexability είναι η πρώτη γραμμή άμυνας κάθε digital presence. Αν αποτύχουν, όλα τα υπόλοιπα — SEO, LLMO, Schema Markup, internal linking — δεν έχουν νόημα. Είναι σαν να χτίζεις ένα εξαιρετικό κατάστημα σε δρόμο που δεν υπάρχει σε κανένα χάρτη.

Αυτό το άρθρο εξηγεί ακριβώς τι είναι το crawlability και το indexability, γιατί είναι κρίσιμα για LLMO — και πώς να τα ελέγξεις και να τα διορθώσεις.

Τι είναι Crawlability

Crawlability είναι ο βαθμός στον οποίο τα search engine bots (crawlers) μπορούν να βρουν, να επισκεφθούν και να διαβάσουν τις σελίδες ενός website. Το πρόγραμμα της Google που κάνει αυτή τη δουλειά ονομάζεται Googlebot.

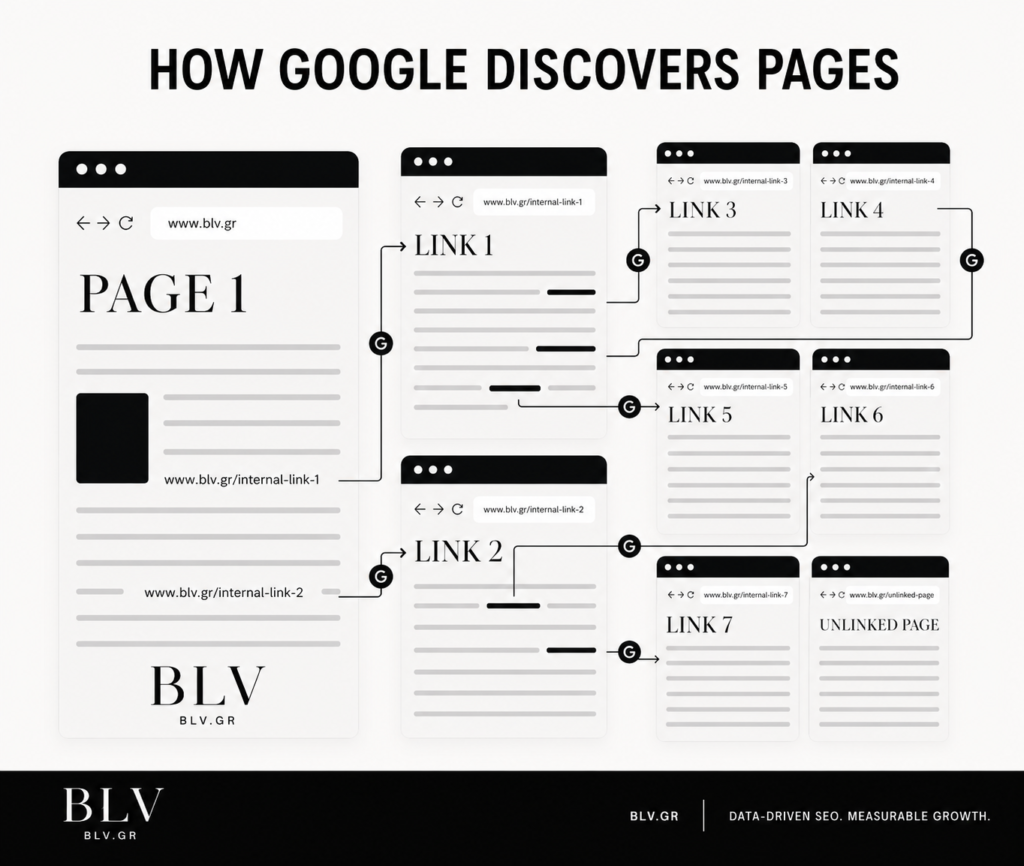

Το Googlebot εξερευνά το web ακολουθώντας links — ακριβώς όπως ένας χρήστης. Αρχίζει από γνωστές URLs, βρίσκει links σε νέες σελίδες, τις επισκέπτεται, βρίσκει περισσότερα links, και συνεχίζει. Αν μια σελίδα σου δεν έχει κανένα incoming link από κάπου που το Googlebot ήδη γνωρίζει — και δεν είναι στο XML sitemap — πρακτικά δεν υπάρχει για τη Google.

Το crawlability επηρεάζεται από:

- Την ταχύτητα και διαθεσιμότητα του server σου

- Τους κανόνες στο

robots.txtαρχείο - Τη δομή του internal linking

- Τα JavaScript rendering requirements του site

- Το crawl budget που η Google κατανέμει στο domain σου

Τι είναι Indexability

Indexability είναι κάτι διαφορετικό — και πολλοί τα μπερδεύουν. Μια σελίδα μπορεί να είναι crawlable αλλά όχι indexable.

Indexability είναι η ικανότητα του Googlebot να αποθηκεύσει μια σελίδα στο Google Index — τη γιγαντιαία βάση δεδομένων από την οποία αντλούνται τα search results. Αν η σελίδα δεν μπει στο index, δεν εμφανίζεται ποτέ στα αποτελέσματα αναζήτησης.

Μια σελίδα μπορεί να μην indexaρεστεί αν:

- Έχει

meta robotstag μεnoindex - Έχει χαμηλή ποιότητα content που η Google κρίνει ως thin ή duplicate

- Είναι canonical σε άλλη URL (η “κύρια” εκδοχή indexaρεται, οι duplicates όχι)

- Έχει

X-Robots-Tag: noindexστο HTTP header - Φορτώνει εξαιρετικά αργά ή έχει σοβαρά Core Web Vitals issues

Η κρίσιμη διαφορά: Crawling = Google βρίσκει και διαβάζει τη σελίδα. Indexing = Google αποφασίζει να την κρατήσει και να την εμφανίσει. Και τα δύο πρέπει να δουλεύουν για να υπάρχεις στα αποτελέσματα.

Πώς λειτουργεί το Googlebot — τα 3 στάδια

Σύμφωνα με την επίσημη τεκμηρίωση της Google, η διαδικασία έχει τρία διακριτά στάδια:

Στάδιο 1: Crawling

Το Googlebot κατεβάζει text, images και video από σελίδες που εντοπίζει στο internet. Χρησιμοποιεί algorithmic process για να αποφασίσει ποια sites θα crawl-αρει, πόσο συχνά, και πόσες σελίδες από κάθε site. Αυτό το “budget” ονομάζεται crawl budget — και δεν είναι άπειρο.

Σημαντικό: Το Googlebot χρησιμοποιεί τελευταία έκδοση του Chrome για να κάνει render τις σελίδες — άρα βλέπει ό,τι βλέπει ο browser. Αν το content σου φορτώνεται μόνο με JavaScript και το rendering αποτύχει, το Googlebot δεν βλέπει το content.

Στάδιο 2: Indexing

Μετά το crawling, η Google αναλύει το content και αποφασίζει αν θα το αποθηκεύσει στο index. Εξετάζει: text, images, videos, title tags, meta descriptions, structured data, και signals σχετικά με την ποιότητα του content. Σε αυτό το στάδιο αποφασίζεται και ποια είναι η canonical version μιας σελίδας όταν υπάρχουν duplicates.

Στάδιο 3: Serving search results

Όταν ο χρήστης κάνει αναζήτηση, η Google ανακτά από το index τα πιο relevant αποτελέσματα βάσει εκατοντάδων ranking factors. Η σελίδα σου μπορεί να είναι indexed αλλά να μην εμφανίζεται αν δεν είναι αρκετά relevant ή αρκετά authoritative για το συγκεκριμένο query.

Crawlability, Indexability και LLMO: η σύνδεση

Εδώ είναι το κομμάτι που σχεδόν κανείς δεν εξηγεί: τα LLMs που τροφοδοτούν το ChatGPT, το Gemini, το Claude και το Perplexity δεν λειτουργούν ανεξάρτητα από το Google index.

Τα AI search systems αντλούν πληροφορίες από:

- Training data — web content που crawl-αρίστηκε και indexaρίστηκε πριν από το training cutoff

- Real-time retrieval (RAG) — live search results από το Google index και άλλες πηγές

- Direct crawling — ορισμένα LLMs (Perplexity, Bing AI) κάνουν real-time crawl

Αν η σελίδα σου δεν είναι indexed από τη Google, είναι πρακτικά αδύνατο να εμφανιστεί σε AI-generated απαντήσεις — είτε μέσω training data, είτε μέσω RAG retrieval. Το crawlability και το indexability είναι η προϋπόθεση κάθε LLMO στρατηγικής.

Δεν έχει νόημα να επενδύεις σε LLMO optimization και Schema Markup αν το Googlebot δεν μπορεί πρώτα να φτάσει τις σελίδες σου. Είναι σαν να βάζεις premium fuel σε αυτοκίνητο που δεν ανάβει.

Τα 6 πιο συνηθισμένα προβλήματα crawlability

1. Λανθασμένο robots.txt

Το robots.txt αρχείο βρίσκεται πάντα στο domain.gr/robots.txt και λέει στα crawlers ποιες σελίδες ΔΕΝ επιτρέπεται να επισκεφθούν. Ένα λανθασμένο robots.txt μπορεί να block-αρει ολόκληρο το site.

Κλασικό λάθος:

User-agent: *

Disallow: /Αυτό block-αρει όλα τα crawlers από όλες τις σελίδες. Αν το δεις στο site σου, διόρθωσέ το αμέσως. Το σωστό για site που θέλεις να crawl-αρεστεί πλήρως:

User-agent: *

Disallow:

Sitemap: https://domain.gr/sitemap.xml2. Noindex σε λάθος σελίδες

Το <meta name="robots" content="noindex"> tag λέει στη Google να μην index-αρει τη σελίδα. Είναι χρήσιμο για thank-you pages, admin pages, duplicate content. Αλλά αν μπει κατά λάθος σε σημαντικές σελίδες — pillar articles, service pages, blog posts — αυτές εξαφανίζονται από τα αποτελέσματα.

Ελέγξτε τα noindex tags σας μέσω Google Search Console → Coverage → Excluded.

3. Orphan pages χωρίς internal links

Σελίδες που δεν παίρνουν κανένα incoming internal link είναι πρακτικά αόρατες για το Googlebot — ακόμα και αν υπάρχουν στο XML sitemap. Το Googlebot ακολουθεί links. Αν δεν υπάρχουν links που οδηγούν σε μια σελίδα, το crawl budget δεν “φτάνει” εκεί. Αυτός είναι ένας από τους λόγους που το internal linking είναι τόσο κρίσιμο.

4. JavaScript-heavy content χωρίς SSR

Αν το content σου φορτώνεται αποκλειστικά μέσω JavaScript (client-side rendering), το Googlebot μπορεί να μην το δει — ή να το δει με καθυστέρηση. Το Googlebot κάνει render JavaScript, αλλά αυτό γίνεται σε δεύτερο στάδιο και με χαμηλότερη προτεραιότητα. Server-side rendering (SSR) ή static generation είναι η ασφαλέστερη επιλογή για crawlability.

5. Αργός server ή잦α server errors

Αν ο server σου επιστρέφει συχνά 500 errors ή φορτώνει αργά, το Googlebot μειώνει αυτόματα το crawl rate — προκαλώντας μείωση του crawl budget. Η Google ερμηνεύει τα HTTP 500 errors ως σήμα να “επιβραδύνει”. Αν ο server είναι unreliable, σελίδες παραμένουν uncrawled.

6. Crawl depth βαθύτερα από 3 clicks

Σελίδες που απαιτούν περισσότερα από 3 clicks από την αρχική σελίδα για να φτάσεις σε αυτές θεωρούνται “βαθιές” από το Googlebot — και λαμβάνουν λιγότερο crawl budget. Αν σημαντικές σελίδες σου είναι θαμμένες βαθιά στην αρχιτεκτονική, χρειάζονται direct internal links από high-authority pages.

Τα 4 πιο συνηθισμένα προβλήματα indexability

1. Duplicate content χωρίς canonical tags

Αν το ίδιο content εμφανίζεται σε πολλαπλά URLs (π.χ. με και χωρίς trailing slash, με και χωρίς www, με URL parameters), η Google δεν ξέρει ποια έκδοση να indexαρει. Το αποτέλεσμα: καμία από τις εκδοχές δεν rank-αρει σωστά.

Η λύση είναι το rel="canonical" tag που ορίζει ρητά ποια είναι η “κύρια” εκδοχή:

<link rel="canonical" href="https://blv.gr/crawlability-indexability-seo/" />2. Thin content

Σελίδες με λίγες λέξεις, χωρίς ουσιαστική πληροφορία, ή με content που αντιγράφει άλλες πηγές. Η Google αποφασίζει να μην indexαρει σελίδες που δεν προσφέρουν αξία στον χρήστη. Minimum viable content για indexability: 300+ λέξεις, original insights, σαφής απάντηση σε user intent.

3. Redirect chains

Αν το URL A ανακατευθύνει στο URL B, που ανακατευθύνει στο URL C, η Google χάνει link equity σε κάθε redirect. Μετά από 3+ redirects, το Googlebot μπορεί να σταματήσει να ακολουθεί. Κάθε redirect chain πρέπει να κόβεται — direct redirect από A στο τελικό URL C.

4. Χαμηλό Core Web Vitals score

Η Google χρησιμοποιεί page experience signals — συμπεριλαμβανομένων των Core Web Vitals — ως factor για το indexing και το ranking. Σελίδες με πολύ χαμηλό LCP (Largest Contentful Paint), υψηλό CLS (Cumulative Layout Shift) ή αργό INP (Interaction to Next Paint) μπορεί να indexαρεστούν αλλά να rank-αρουν χαμηλά λόγω poor page experience.

Πώς ελέγχεις αν το site σου crawl-αρεται σωστά

Τρία εργαλεία — δωρεάν, άμεσα, αξιόπιστα:

Google Search Console — το πιο σημαντικό

Στο Google Search Console → Coverage βλέπεις:

- Valid: σελίδες που είναι indexed και εμφανίζονται στα αποτελέσματα

- Valid with warnings: indexed αλλά με issues

- Excluded: σελίδες που δεν indexαρίστηκαν — και γιατί (noindex, duplicate, crawled but not indexed, κ.λπ.)

- Error: σελίδες που απέτυχαν στο crawling ή indexing

Το “Crawled — currently not indexed” status είναι ιδιαίτερα σημαντικό: σημαίνει ότι το Googlebot βρήκε τη σελίδα αλλά αποφάσισε να μην την κρατήσει — συνήθως λόγω thin content ή duplicate.

Επίσης στο Search Console: Settings → Crawl stats σου δείχνει πόσες σελίδες crawl-αρει η Google ημερησίως, ποια είναι τα response codes που λαμβάνει, και αν υπάρχουν server errors.

URL Inspection Tool

Μέσα στο Search Console, το URL Inspection Tool σου επιτρέπει να ελέγξεις οποιαδήποτε συγκεκριμένη URL: αν είναι indexed, πότε crawl-αρίστηκε τελευταία φορά, αν υπάρχουν canonical issues, και αν το rendered version έχει διαφορές από το HTML source.

robots.txt Tester

Στο Search Console → Settings → robots.txt μπορείς να ελέγξεις αν το robots.txt αρχείο σου block-αρει κατά λάθος σημαντικές σελίδες. Πληκτρολογείς ένα URL και βλέπεις αν το Googlebot επιτρέπεται να το επισκεφθεί.

Γρήγορο self-check με Google

Πληκτρολόγησε στη Google: site:domain.gr. Ο αριθμός αποτελεσμάτων που εμφανίζεται δείχνει (κατά προσέγγιση) πόσες σελίδες σου είναι indexed. Αν έχεις 90 URLs και εμφανίζονται μόνο 40 αποτελέσματα, έχεις indexability πρόβλημα.

Θέλεις technical SEO audit;

Το crawlability και indexability audit είναι το πρώτο πράγμα που κάνουμε σε κάθε νέο project στη BLV. Πριν μιλήσουμε για LLMO, GEO ή content strategy — ελέγχουμε αν το Google βλέπει πρώτα αυτό που υπάρχει.

Αν έχεις site με 50+ σελίδες και δεν έχεις κάνει ποτέ crawlability audit, υπάρχει σχεδόν σίγουρα κάτι που χάνεις.

Ζήτα δωρεάν LLMO & Technical SEO Audit →

Συχνές ερωτήσεις για Crawlability & Indexability

Ποια είναι η διαφορά μεταξύ crawling και indexing;

Crawling είναι η διαδικασία με την οποία το Googlebot επισκέπτεται και διαβάζει μια σελίδα. Indexing είναι η απόφαση να αποθηκευτεί η σελίδα στη βάση δεδομένων της Google και να εμφανίζεται στα αποτελέσματα. Μια σελίδα μπορεί να crawl-αρεστεί χωρίς να indexαρεστεί — αλλά δεν μπορεί να indexαρεστεί χωρίς πρώτα να crawl-αρεστεί.

Τι είναι το crawl budget και πώς το επηρεάζω;

Crawl budget είναι ο αριθμός σελίδων που το Googlebot crawl-αρει από το site σου σε ένα συγκεκριμένο χρονικό διάστημα. Επηρεάζεται από: το συνολικό μέγεθος του site, την ταχύτητα του server, τον αριθμό σελίδων με errors, και το authority του domain. Για να μεγιστοποιήσεις το crawl budget: καθάρισε orphan pages, διόρθωσε 404 errors, επίτρεψε crawling μόνο σε σελίδες που θέλεις indexed, και βελτίωσε την ταχύτητα του server.

Αν μια σελίδα δεν είναι indexed, μπορεί να εμφανιστεί σε AI search;

Πρακτικά όχι. Τα περισσότερα AI search systems (ChatGPT, Gemini, Perplexity) αντλούν πληροφορίες είτε από training data — που στηρίζεται σε indexed web content — είτε από real-time retrieval μέσω search engines. Αν η σελίδα δεν είναι indexed, δεν υπάρχει σε καμία από αυτές τις πηγές. Το indexability είναι προϋπόθεση για κάθε GEO και LLMO στρατηγική.

Πόσο χρόνο παίρνει να indexαρεστεί μια νέα σελίδα;

Ποικίλει σημαντικά: από λίγες ώρες έως αρκετές εβδομάδες. Νέα domains με χαμηλό authority παίρνουν περισσότερο χρόνο. Για να επιταχύνεις: υπέβαλε το URL μέσω Google Search Console URL Inspection → Request Indexing, βεβαιώσου ότι η σελίδα υπάρχει στο XML sitemap, και πρόσθεσε internal links από ήδη indexed σελίδες.

Τι σημαίνει “Crawled — currently not indexed” στο Search Console;

Σημαίνει ότι το Googlebot επισκέφθηκε τη σελίδα αλλά αποφάσισε να μην την κρατήσει στο index. Οι πιο συνηθισμένοι λόγοι: thin content (λίγες λέξεις, χαμηλή αξία), duplicate content που μοιάζει πολύ με άλλη σελίδα, ή content που δεν ικανοποιεί το search intent για κανένα query. Η λύση είναι βελτίωση του content quality — όχι τεχνικές ρυθμίσεις.

Πρέπει να έχω XML sitemap;

Ναι, πάντα. Το XML sitemap δεν εγγυάται crawling ή indexing, αλλά βοηθά το Googlebot να ανακαλύψει σελίδες που ίσως δεν έχουν incoming internal links — ειδικά σε νέα content. Για WordPress, τα Yoast SEO και RankMath δημιουργούν αυτόματα XML sitemap.

Συμπέρασμα — Τι κρατάς από αυτό το άρθρο

- Crawlability = Google βρίσκει και διαβάζει. Indexability = Google αποφασίζει να κρατήσει. Και τα δύο πρέπει να δουλεύουν

- Σελίδα που δεν είναι indexed δεν υπάρχει — ούτε για Google, ούτε για LLMs και AI search

- Τα 6 κύρια crawlability προβλήματα: robots.txt, noindex, orphan pages, JavaScript rendering, server errors, crawl depth

- Τα 4 κύρια indexability προβλήματα: duplicate content, thin content, redirect chains, Core Web Vitals

- Google Search Console → Coverage είναι το εργαλείο ελέγχου — δωρεάν, άμεσο, αξιόπιστο

- Crawlability audit πριν από οποιαδήποτε άλλη SEO ή LLMO ενέργεια — χωρίς αυτό, τα υπόλοιπα δεν έχουν νόημα

Το crawlability και indexability είναι το foundation — και η BLV ξεκινά πάντα από εδώ στο LLMO Audit. Μόλις το foundation είναι σωστό, προχωράμε σε LLMO optimization, Schema Markup, και internal linking — με τη σιγουριά ότι αυτά που φτιάχνουμε θα τα δει πράγματι η Google.

Σκούφος Νίκος — LinkedIn

Ιδρυτής της BLV Strategic Marketing Media, ειδικός σε LLMO, GEO και Technical SEO για ελληνικές επιχειρήσεις. Πριν από οποιαδήποτε LLMO ή content στρατηγική, ελέγχει πάντα αν το Google βλέπει πρώτα αυτό που υπάρχει — γιατί το καλύτερο content είναι άχρηστο αν δεν crawl-αρεστεί.